Ребята, всем привет!

Для начала представлюсь. Меня зовут Эдуард. Я Data Scientist и AI инженер. Я занимаюсь этим с 2017 года.

Жизнь до Data Science

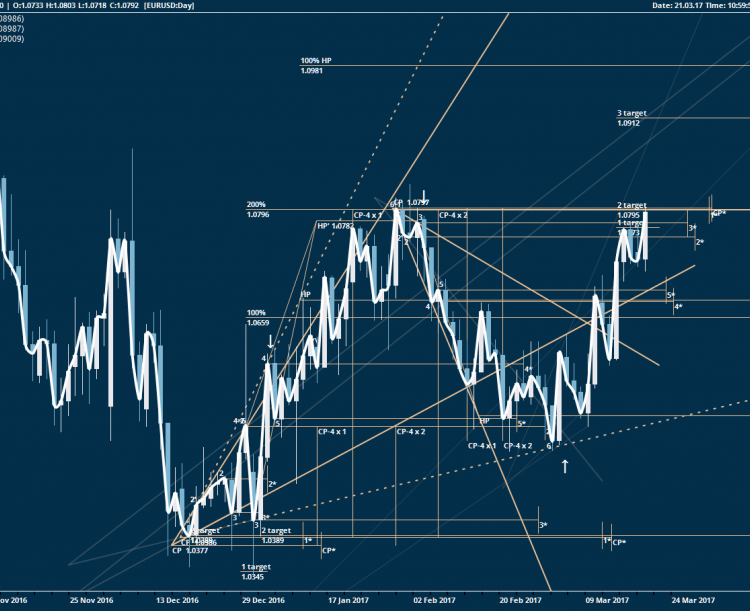

До 2017 года я уже тогда интересовался рынками и был квантом в Ренессанс Капитал. Я занимался маркетмейкингом валютных опционов на USD/RUB на московской бирже, строил альтернативные Блэку-Шоулзу модели ценообразования. Также помогал оценивать справедливую стоимость внебиржевых опционов, которые покупались у других инвестиционных банков. Research в количественных финансов помог мне изучить хорошо R, Python, C и стартануть карьеру в Data Science.

Ранний этап: вход в Data Science

Начинал как джун в 2017 году. Учил R и Python. Работал в компании Neolab. Строил различные алгоритмы кластеризации, классификации. В параллель строил UI-сервисы на Shiny. Интересовался рынками. Мои посты о рынке можно встретить на старом сайте long-short.

X5 Retail Group: эффект важнее моделей

С 2019 года начал делать Data Science в ритейле в X5 Retail Group. Строил алгоритмы анализа конкурентов, модели рисков, занимался A/B-тестированием, построил алгоритмы страхования для огромного автопарка X5.

Посчитали, что суммарно финансовый эффект был где-то в районе 250 млн рублей.

В этот момент я впервые очень чётко осознал одну вещь: Data Science — это не про модели. Это про эффект. И если делать DS правильно, он реально окупается. Это сильно меняет мышление.

Лента: продуктовый ML и перелом мышления

И в 2020 году я начал делать Data Science в Ленте. Моей мечтой было строить продуктовый ML. Я хотел строить алгоритмы, которые бы влияли на бизнес напрямую: на цены, ассортимент, промо.

В Ленту я уже ушёл тимлидом и возглавил в дальнейшем CORE коммерческие продукты:

- оптимизация ассортимента

- динамическое ценообразование

- оптимизация промо (uplift-моделирование)

- управление полочным пространством

- прогноз спроса

Первые алгоритмы я строил сам. Оптимизация ассортимента тогда была задачей, про которую ещё мало кто понимал, как её вообще делать. Я активно совмещал научный подход, много исследовал иностранный опыт, байесовские алгоритмы и собственные идеи и эксперименты. В итоге совместил несколько научных подходов от иностранного ритейлера.

В какой-то момент я понял, что модель ≠ ценность.

Байесовская модель может обучаться три минуты — а мне нужно спрогнозировать 10 миллионов товаров. В этот момент приходится резко упрощать и приземляться.

Байес при этом помогал — вероятностные прогнозы спроса были важны для среднесрочного горизонта прогнозирования, ассортимент быстро не двигается.

Я создал первый алгоритм на Байесе, и уже через полгода мы стартовали первый пилот на трёх гипермаркетах Ленты по ряду товарных категорий. Он показал вполне хороший результат. Дальше я продолжил это развивать.

Команда расширялась. Я стал управлять лидами. Мы запускали пилоты в промо, в ценообразовании. Количество пилотов и роллаутов было одним из моих KPI.

Последние полгода работы в Ленте я был Head of Data Science и руководил всем Data Science Ленты. Я вёл порядка 13 продуктов силами команды из ~30 человек. Это был пик моей реализации в корпоративном Data Science.

В этот момент я понял, что хочу уйти.

Не потому, что стало плохо — а потому что я хотел передать эту работу следующему поколению Data Scientist-ов, которые принесут новые идеи и смыслы. Мне не хотелось превращаться в человека, который просто поддерживает уже построенное.

Райффайзенбанк: аналитика, масштаб и AI

В 2023 году я перешёл в Райффайзенбанк, где возглавил Data Science и Data Analytics в домене Operations как Tech Lead. Причин было несколько. Я хотел сильнее работать с Data Analytics, с отчётностью, хотел банковский опыт.

В Райффайзенбанке я и сейчас и решаю множество продуктовых задач.

Например,

- оптимизация наличных в отделениях и банкоматах

- аналитика для Operations (800+ человек)

- С 2025 года активно развиваю AI-направление: строю AI-агентов, внедряю AI там, где это имеет смысл.

Также я больше двух лет преподавал Data Science и Data Analytics в Яндекс Практикуме и Школе анализа данных. Даже думал о создании своих курсов. Это помогало постоянно улучшать свои технические навыки, глубже понимать и осмыслять ML технологии, быстрее применять теорию на практике.

Возврат к рынкам и собственная инфраструктура

С 2024 года я снова начал работать с рынками — но уже с позиции накопленного технического опыта и масштаба.

Используя свой опыт, я в свободное время построил торговую и data-инфраструктуру, создал бекстовую платформу, начал делать research в количественном инвестировании. Сосредоточился на рынке США.

Что мне удалось сделать:

- бесшовный стриминг market data по топовым акциям и ETF (США → ЕС)

- сбор фундаментальных, построение технических показателей

- сбор макроданных с FRED

- парсинг, сбор и загрузка исторических данных по новостям – API NY Times

- загрузка исторических данных и покрытие data quality проверками

- создание собственного кластера и DWH на ClickHouse

- разворачивание Airflow для ETL процессов внутри кластера

- разворачивание portainer для оркестрации Docker контейнеров – алго систем

- собственный стабильный коннектор к Interactive Brokers Gateway

- VNC инфраструктура на Linux, чтобы пускать алго к коннектору

- создание AI агентов в связке с OPEN AI API для работы с текстами и построение фичей

- построение UI сервиса с регистрацией и запуска стратегий любым пользователем

- и много – много ресерча по количественному инвестированию

- бектестовая платформа, чтобы объединять математику, ML идеи и разные подходы к инвестированию и низкогранулярно гонять тесты

Что получилось в итоге:

Я строил собственную инфраструктуру, чтобы приобрести гибкость в разработке и тестирование идей. До этого я пробовал QuantConnect. И довольно быстро понял, что взять научную статью и нормально её имплементировать — тяжело. Огромная библиотека, часть функционала закрыта коммерчески. Месяцы и годы обучения — и ты становишься заложником того, как платформа развивается дальше.

Я начал делать много research и тестировать разные подходы к «умному инвестированию».

Сразу поставил себе жёсткие рамки:

- не использовать короткие позиции (только BUY стратегии с управлением размером позиции)

- не делать black box (стратегия объяснима, каждый может затестить)

- не использовать leverage

- не внедрять ML в трейдинг

Я, конечно, пробовал ML в рынке когда-то давно. Делал классификатор отбора акций по фундаментальным показателям. На истории всё выглядело хорошо. На практике всё ломалось — связи постоянно меняются.

В продуктовом ML это не так: покупательское поведение устойчиво и хорошо объясняется.

В рынке — нет. Для себя я сделал простой вывод: ML в рынке для меня пока не работает.

Меня интересует именно количественное инвестирование:

- поведение классов активов в разные периоды

- макроэкономические режимы (да, да они существуют уже почти 80 лет))))

- фундаментальные показатели в разных фазах рынка

- отдельной темой стала волатильность — её влияние на рост индексов и риск

Продакшен, реальные сделки и психология

Понимая, что я строю BUY ONLY алгоритм, я для себя определил ключевые метрики:

- CAGR

- Max Drawdown

- количество сделок

- Calmar Ratio

- налоги от преждевременной реализации позиции

В марте 2025 года я вывел алгоритм в PROD. Он начал торговать американскими ETF через Interactive Brokers. Сделки совершаются полностью автоматически и продолжаются с марта по текущий момент. Здесь есть много графиков и описаний как ведут себя стратегии в разные периоды. Перформанс обновляется ежедневно.

Все сделки и доходность подтверждаются брокерским отчётом IB.

В первые дни важнее всего было обеспечить стабильность автоматического execution — не доходность. Самое ироничное, что почти сразу после запуска началась торговая война. Алгоритм с этим справился. Это я расскажу отдельным постом.

В сентябре стратегия дала около +5%. Росло золото в портфеле. Хороший месяц. И при этом было ощущение аномалии. В такие моменты, на мой взгляд, самое сложное — не поддаться эйфории, не вмешиваться и не начать ломать логику стратегии.

Что я хочу от Smartlab

- Рассказывать открыто про свои стратегии, получить критику и обратную связь. За время работы в Data Science я понял, что единственный верный путь развития — обмен знаниями. Рассчитываю, что зачеленжите.

- Поделиться техническим опытом развития инфраструктуры. Буду делиться и опытом, и кодом, и технологиями, и развитием.

- Писать про релизы и ресерчи — что усиливает метрики, а что нет, и «сверять часы», туда ли я копаю с профессиональным коммьюнити.

- Я завернул сейчас всё это в удобный понятный сервис. Он пока бесплатный. Хочу собирать с коммьюнити пользовательский фидбек.

В общем, надеюсь, будет интересно.

Также я активно делюсь новостями, результатами в ТГ канале

Подробнее https://smart-lab.ru/compa...