Добрый вечер, коллеги!

В последние годы, месяцы и дни растет и поднимается хайп по поводу AI, #программистыненужны и прочих плюшек, реально упрощающих процесс разработки программного обеспечения.

В этих тезисах есть много правды, но и есть много лукавства.

Любой юзер Cursor (или Windsurf и чего-то подобного), захлебываясь от восторга пишет на Reddit, как легко:

— объяснить модели, какой код ты хочешь написать

— давать простые правки к коду в диалоговом режиме

— (в случае фантастической лени) давать подобные правки голосом

И да — это не фантастика уже почти год. В самом деле, в Cursor или связке Cursor/Figma (если вы ваяете сайты) реально можно давать команды голосом:

— подвинь эту менюшку налево

— наложи здесь зеленый с голубым фон

— поставь здесь плюшку с меню и подвинь ее на 10 ppt вправо

И это реально работает!

Теперь спустимся с небес на бренную землю. Буду говорить только за себя.

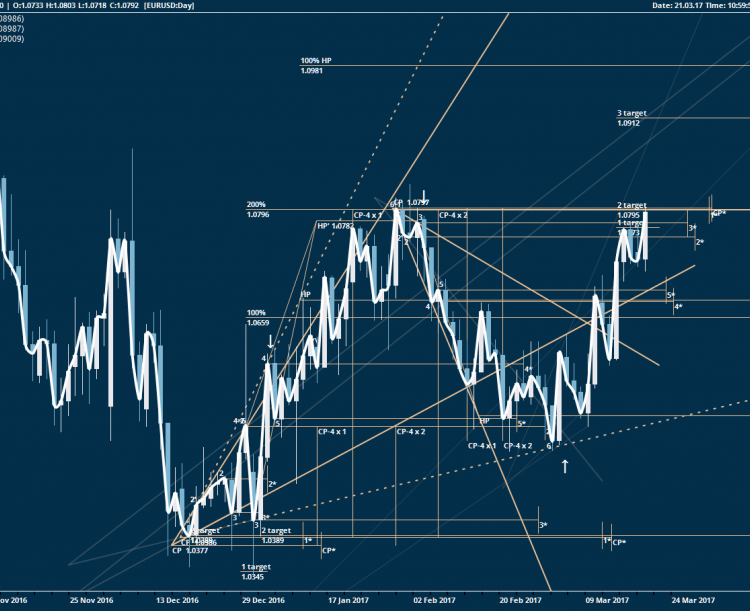

Лично я занимаюсь (уже с помощью LLM) разработкой и тестированием весьма сложных математических моделей рынка. И готов поделиться практическим опытом применения LLM ***Code в реальных кейсах. Тут все не так шоколадно.

1. Вполне возможно разрабатывать сложный (математический) софт методом итераций. Ну т.е. вместо «подвинь эту менюшку влево» ты пишешь «поиграйся с этими коэффициентами». В итоге все это приводит (в отличие от генерации интерфейсного кода) к лютому трешу — после пары-тройки десятков итераций код просто перестает работать. Это легко понять, если знать, как работает machine learning — с каждой следующей итерацией в диалоге профильные коэффициенты выравниваются — и модель начинает генерировать бред, независимо от глубины контекстного окна. В реале на сегодня 30-40 запросов в чате — это практический порог до перехода в мусор.

2. Таким образом лучше, чтобы задача решалась не за 30-40, а за 2-3 итерации. В теории это тоже возможно, но для этого приходится писать стартовый и последующие промпты размером со страницу A4 с разметкой в формате markup и достаточно детальные. И даже в таком сценарии использования старые модели OpenAI (o3pro, pro5) косячили #неподеццки. Прогресс начался с 5.2pro (мой фаворит), сейчас сижу (вынужденно) на 5.4pro. Она очень неровная, что-то делает в одно касание, но умудряется постоянно допускать мелкие косяки.

3. Соответственно, картинной легкости в реальном Vibe Coding нет и в помине. Сначала ты пишешь аккуратно размеченное ТЗ строк на 50, потом 30-60 минут ждешь от модели pro правильного ответа, потом знакомишься с простыней ответа строк на 500, потом пишешь такое же аккуратное исправление в markup еще на 1 страницу, потом надеешься, что не уйдешь за 30 итераций… В итоге на серьезной задаче весь день потерян.

4. Такой режим (составление подробного ТЗ/часовая пауза/составление подробной коррекции/часовая пауза...) в реале приводит к сильной усталости и выгоранию. Да, я поднял свою личную эффективность в 100+ раз за последние 2 года, научился относительно легко решать задачи, за которые бы раньше вообще не брался, но весь этот сложный трэш приводит к систематической усталости и выгоранию. За рабочий день тебе приходится изучить 50+ страниц формата A4 сложного технического текста (еще больше с вложениями кода)

Поэтому сказки про комфортный Vibe Coding — это всего лишь сказки (ну или правда для разработчиков веб-интерфейсов и простого ненагруженного бэкенда). Для всех остальных модель работы с LLM «Ну ка быстро набросай мне прототип/подправь это и это тоже/теперь поменяй этот формат и быстро выложи мне готовый код для production» — это просто новый метод генерации говнокода, который при сравнимых затратах и качестве знакомый индус наваяет за миску риса, а знакомый китаец — за миску лапши.

Как-то так

Что вы думаете по этому поводу, коллеги?

С уважением

Подробнее https://smart-lab....

Блеск и нищета Vibe Coding

2026-03-25 20:09:36